Online-Diskussionsreihe

- Dienstag, 17. November 2020 19.00 – 20.00 Uhr In meinem Kalender speichern

Women Take on the Digital Divide: 6-teilige Veranstaltungsreihe zur digitalen Transformation

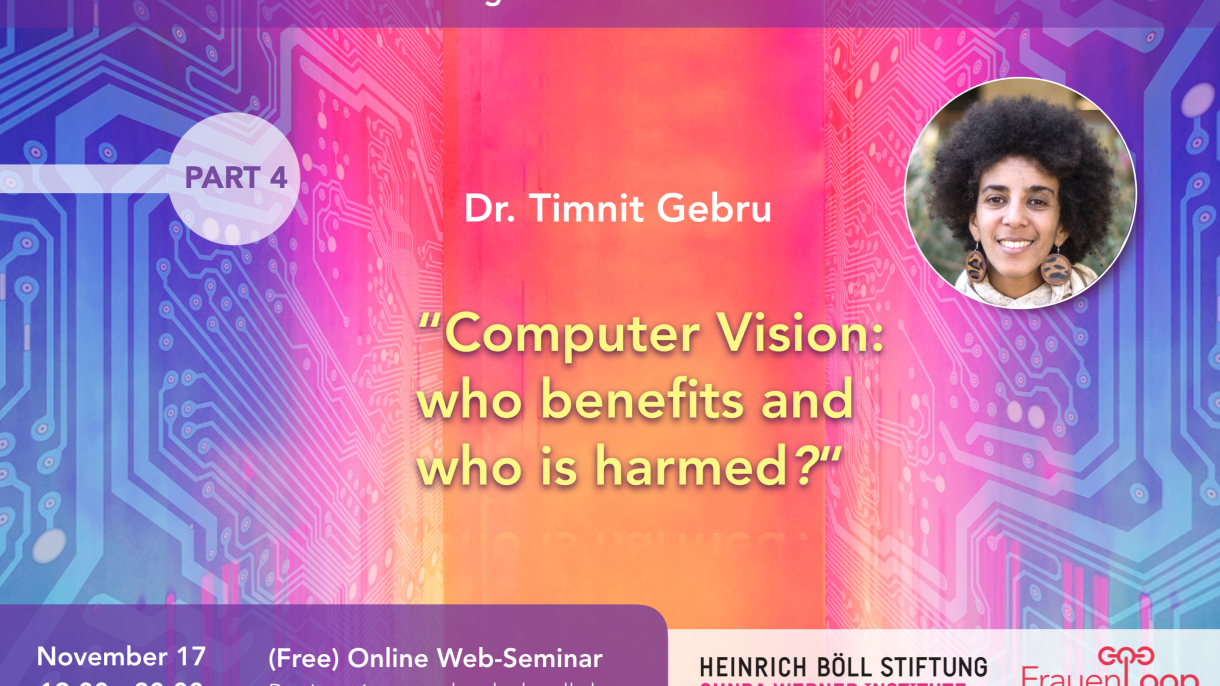

Teil 4/ Computervision: Wer gewinnt und wer verliert?

Computervision (als Teilbereich der Künstlichen Intelligenz) ist nicht mehr nur ein rein akademisches Unterfangen. Von Strafverfolgung über Grenzkontrolle bis hin zur Diagnostik im Gesundheitswesen werden Computervision-Systeme aktuell in alle Aspekte der Gesellschaft integriert.

Das Projekt Gender Shades hat gezeigt, dass kommerzielle Systeme zur Klassifizierung der Geschlechter große Unterschiede in der Fehlerquote nach Hauttyp und Geschlecht aufweisen. Weitere wissenschaftliche Arbeiten zeigen und diskutieren die Schäden, die durch die bloße Existenz automatischer Systeme zur Erkennung des Geschlechts verursacht werden. Jüngste Arbeiten haben auch schockierende rassistische und sexistische Bezeichnungen in populären Computervision-Datensätzen aufgedeckt - mit dem Ergebnis, dass einige davon entfernt wurden.

Heute gibt es in der Forschung Arbeiten, die vorgeben, die Sexualität einer Person anhand ihrer Profilbilder in sozialen Netzwerke zu bestimmen, und andere, die behaupten, "gewalttätige Personen" anhand von Drohnenaufnahmen zu klassifizieren. Ein kritischer öffentlicher Diskurs über den Einsatz von auf Computervisionen basierenden Technologien nimmt jedoch zu. Der Einsatz von Gesichtserkennungstechnologien durch Polizeibehörden ist in den USA heftig kritisiert worden, und als Reaktion darauf haben Unternehmen wie Microsoft, Amazon und IBM ihre Dienstleistungen im Bereich der Gesichtserkennungssoftware zurückgezogen oder eingestellt.

In ihrem Vortrag wird Dr. Timnit Gebru einige der Probleme und Lösungsvorschläge, die die algorithmische Bias (Voreingenommenheit) abschwächen sollen, vorstellen. Sie wird zeigen, dass einige der vorgeschlagenen Korrekturen das Problem eher verschärfen als abschwächen könnten.

Diskussion mit:

Dr. Timnit Gebru, Informatikerin und technische Co-Leiterin des Ethical Artificial Intelligence Team bei Google, Co-Autorin Gender Shades

Dr. Nakeema Stefflbauer, FrauenLoop

Francesca Schmidt, Gunda Werner Institut

____________________

Hinweis

Wir weisen darauf hin, dass die Online-Veranstaltung im Programm Zoom stattfindet. Für die Teilnahme benötigen Sie je nach Veranstaltung (mit Beteiligung des Publikums) optional eine Kamera und/oder ein Mikrofon.

Sie können entweder das Client-Programm oder die App nutzen. Mit den Browsern Chrome und Edge können Sie direkt über den Zugangslink teilnehmen. Weitere Information zur Handhabung von Zoom finden Sie hier. Bitte achten Sie darauf, dass Sie die neueste Version von Zoom verwenden, damit Sie über die nötigen Einstellungen verfügen.

Die Zugangsdaten zur Online-Veranstaltung zu Zoom erhalten Sie 24 Stunden und erneut 2 Stunden vor der Veranstaltung per E-Mail.

Es gelten unsere Datenschutzbestimmungen. Für die Verwendung der Software Zoom übernimmt die Heinrich-Böll-Stiftung keine Haftung. Die geltenden Datenschutzrichtlinien von Zoom finden Sie hier.

- Veranstaltungsreihe

- "Women Take on the Digital Divide" – A Public Event Series

- Adresse

-

▶ Online-Veranstaltung

- Veranstalter*in

- Gunda-Werner-Institut für Feminismus und Geschlechterdemokratie

- Rechtliches

- Allgemeine Geschäftsbedingungen

- Sprache

- Englisch